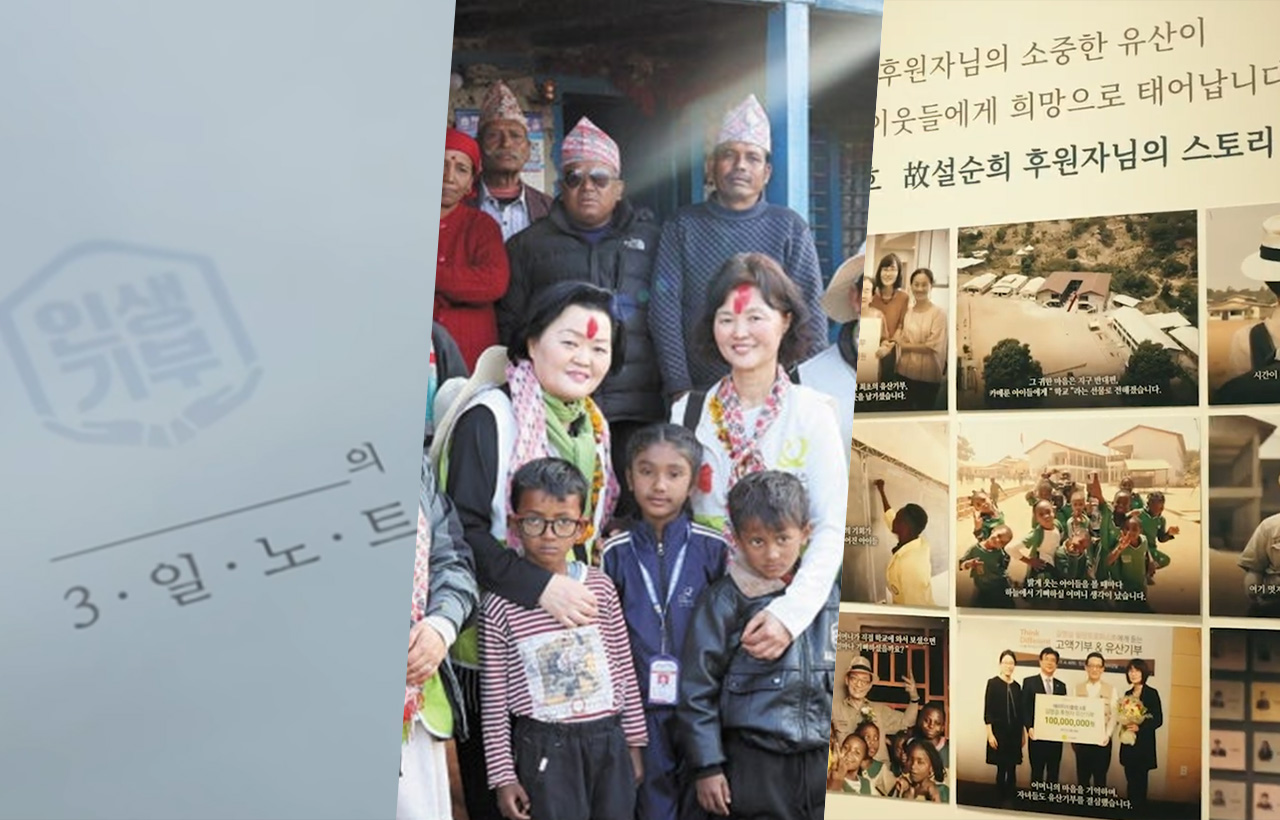

단체가 보는 K-유산기부의 현실 <5>‘남기는 것’을 넘어 ‘돌보는 것’으로 유산기부 상담 현장에서 최근 반복적으로 등장하는 질문이 있다. 재산을 사회에 남기겠다는 의사와 함께 “나를 돌봐줄 수 있느냐”는 문의다. 고령 1인 가구가 늘어나면서 유산기부는 단순한 자산 이전을 넘어 ‘돌봄’의 문제와 맞닿기 시작했다는 신호다. 실제로 일부 기관에는 기부 상담을 계기로 관계를 맺고 싶어 하거나, 생애 말기 돌봄과의 연결 가능성을 묻는 사례가 이어진다. 가족 중심의 돌봄 구조가 약해지면서, 유산기부가 관계의 공백을 드러내는 창구가 되고 있다고 분석된다. ◇ 유산이 향하는 곳은 ‘돌봄’…상속 패러다임의 변화 유산기부는 자산만의 문제가 아니다. 관계와 돌봄의 문제이기도 하다. 한 실무자는 “수십억 원대 자산가인 고령 후원자가 상담 과정에서 한 시간 만에 자신의 삶을 모두 털어놓으며 임종과 장례까지 맡아줄 수 있는지를 물어봤다”며 “경제적 여유와 별개로, 돌봄을 요청할 관계가 없는 ‘고립’ 상태를 마주하는 경우가 많다”고 이야기했다. 이처럼 유산기부 상담은 단순한 후원 안내를 넘어 ‘생애 설계 상담’으로 바뀌는 중이다. 과거에는 자녀가 재산을 상속받는 대신 부모의 노후를 책임지는 구조가 일반적이었다. 그러나 가족 중심의 돌봄 체계가 약해지면서, 그 역할을 비영리나 공공이 일부 나누어 맡기 시작했다. 고영주 희망친구 기아대책 IMC본부 차장은 “1인 가구 고령층에게는 단체와의 지속적인 관계와 소통 자체로도 의미가 크다”며 “앞으로 NGO의 역할이 단순 후원을 넘어 확장될 것”이라고 내다봤다. 그러나 현장에서 부딪히는 한계도 분명하다. 기부자는 ‘관계로서의 돌봄’을 기대하지만, NGO는 기부금을 통해 취약계층을 지원하는 조직이다. 직접 돌봄이나 후견을