美 배심원단, 메타·구글의 ‘무한 스크롤·중독 유도’에 거액 배상 판결

xAI ‘그록’ 등 생성형 AI 서비스도 성착취물 방지 의무 강화 추세

미국에서 메타와 구글의 소셜미디어 설계 책임을 인정한 배심원 평결과 메타의 아동 보호 책임을 인정한 판결이 잇따라 나왔다. 이를 계기로 IT기업 책임 논의가 콘텐츠 관리에서 플랫폼 설계와 운영 방식까지 확대되는 흐름이 나타난다.

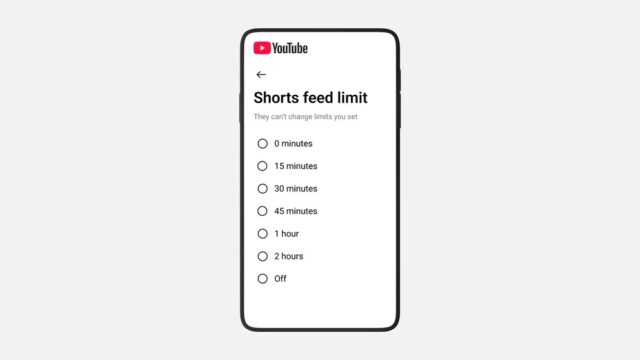

지난 3월 25일(현지시간) 미국 캘리포니아주 로스앤젤레스 배심원단은 메타와 구글이 각각 인스타그램과 유튜브의 설계·운영 과정에서 과실이 있으며, 서비스 이용에 따른 위험을 충분히 알리지 않았다고 판단했다. 재판에서는 무한 스크롤과 자동 재생 등 이용 시간을 늘리도록 설계된 기능과 추천 구조가 쟁점이 됐다. 이러한 이용 방식이 한 젊은 이용자의 우울증과 자살 충동 등 정신 건강 문제로 이어진 것으로 봤다. 배심원단은 메타에 420만 달러(약 63억5000만 원), 구글에 180만 달러(약 27억2000만 원)의 손해배상 책임을 인정했다.

바로 전날인 3월 24일, 뉴멕시코주 법무당국이 메타를 상대로 제기한 소송에서도 배상 책임이 인정됐다. 법원은 메타가 어린 이용자들에게 플랫폼의 안전성을 충분히 설명하지 않은 채, 아동이 성적 노출이나 성범죄자 접촉 위험에 노출될 수 있는 환경을 방치했다고 판단했다. 배상액은 3억7500만 달러(약 5700억 원)에 이른다.

이 같은 판결은 지난 30년간 온라인 플랫폼을 소송으로부터 보호해 온 통신품위법 230조(Section 230) 해석에도 영향을 미친다. 이 법은 기본적으로 이용자가 올린 콘텐츠에 대해 플랫폼이 책임을 지지 않도록 하는 장치다. 그런데 최근 소송에서는 ‘무엇이 올라왔는지’보다 플랫폼이 서비스를 어떻게 설계하고 운영했는지, 또 이용자에게 위험을 충분히 알렸는지가 더 중요한 쟁점으로 떠올랐다.

◇ 스냅챗·로블록스·틱톡까지…아동 보호 앞세운 규제 확산

세계 각국은 개별 플랫폼을 겨냥한 규제를 강화하고 있다. 유럽연합(EU)은 3월 스냅챗의 아동 보호 조치와 불법 콘텐츠·상품 차단이 충분했는지 조사에 착수했다. 이번 조사는 디지털서비스법(DSA)에 근거하며, 위반이 확인되면 전 세계 연간 매출의 최대 6%에 해당하는 벌금을 부과할 수 있다.

프랑스에서는 교육부가 3월 26일 틱톡이 청소년의 과도한 화면 이용과 정신 건강 문제에 영향을 미칠 가능성이 제기된다며 사건을 파리 검찰에 넘겼다. 앞서 프랑스 사법당국은 틱톡 알고리즘이 청소년의 극단적 선택을 유도할 수 있는지에 대한 조사에도 착수했다.

일부 국가에서는 아동 보호를 이유로 이용 제한과 함께 플랫폼의 책임을 강화하는 정책도 추진된다. 인도네시아는 3월부터 로블록스 등 특정 플랫폼을 중심으로 16세 미만 청소년 이용 제한 조치를 도입했고, 프랑스는 1월 하원이 15세 미만 청소년의 소셜미디어 이용을 제한하는 법안을 통과시키며 강력한 연령 인증 의무를 도입했다.

◇ 딥페이크·챗봇 규제…AI로 확장되는 책임 논의

플랫폼을 둘러싼 책임 논의는 인공지능(AI) 서비스로도 확장된다. 네덜란드 법원은 3월 26일(현지시간) 일론 머스크의 xAI와 챗봇 ‘그록(Grok)’에 대해 비동의 성적 이미지 생성 및 배포를 금지하도록 명령했다. 이를 위반할 경우 하루 최대 10만 유로(한화 약 1억7000만 원)의 벌금을 부과할 수 있다.

미국 메릴랜드주 볼티모어시는 3월 24일 그록이 비동의 성적 이미지와 아동 관련 문제성 콘텐츠를 생성했다며 소송을 제기했다. 기업이 이러한 기능을 충분히 통제하지 못했다는 점이 주요 쟁점이다.

유럽에서도 관련 입법 논의가 이어진다. 독일에서는 3월 딥페이크 음란물 제작을 처벌하는 법안이 추진되고 있으며, 피해자가 불법 콘텐츠 계정 소유자의 신원을 확인하고 손해배상을 청구하거나 계정 차단을 요구하기 쉽게 하는 방안도 포함됐다. 이와 함께 독일 정부는 X 등 온라인 플랫폼이 디지털 성폭력 확산에 더 큰 책임을 져야 한다고 촉구했다.

채예빈 더나은미래 기자